動画生成AIを試してみたいけれど、クラウド環境で実行するのは、プライバシーや検閲が心配という方もいると思います。HunyuanVideoであれば、ローカル環境でも実行できるので、誰にも見られることはなく、自由に動画生成を試すことができます。ただし、ハイスペックPCは必要となります。この記事では、Stability MatrixとComfyUIを用いて、Windowsのローカル環境でHunyuanVideoを実行する方法をご紹介します。

HunyuanVideoとComfyUIの概要

HunyuanVideoの概要と、ローカル環境で実行するために必要なスペック、必要なツールについてご紹介します。

HunyuanVideoとは

「HunyuanVideo」とは、中国のTencent(テンセント)が開発した動画生成AIモデルです。

テキストプロンプトからの動画生成(t2v)と、画像からの動画生成(i2v)が可能です。

ライセンスを含めた厳密なオープンソースではありませんが、ソースコードはGitHubで公開されています。

ローカルであれば無料で利用できます。

「Hunyuan(混元)」とは、中国思想で陰陽が分化する前の混ざりあった状態のことです。

ローカルで実行するには?

現在、HunyuanVideoをローカル環境で実行するためのツールが、多くのユーザーによって開発されています。

日々進化しているので、どれが最適なのかは分かりません。

この記事では、比較的ユーザーが多いと思われるComfyUI(Stability Matrix)を使った方法をご紹介します。

ComfyUIとは

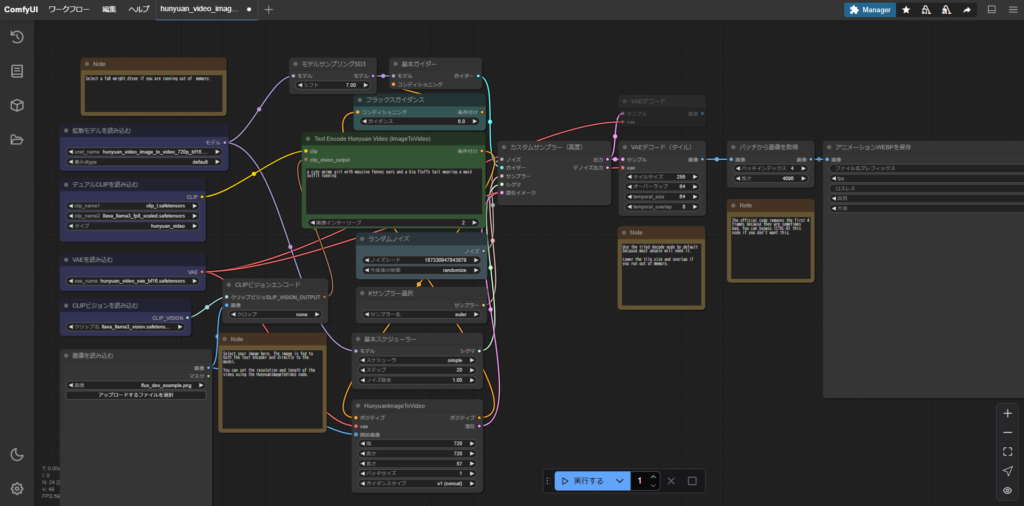

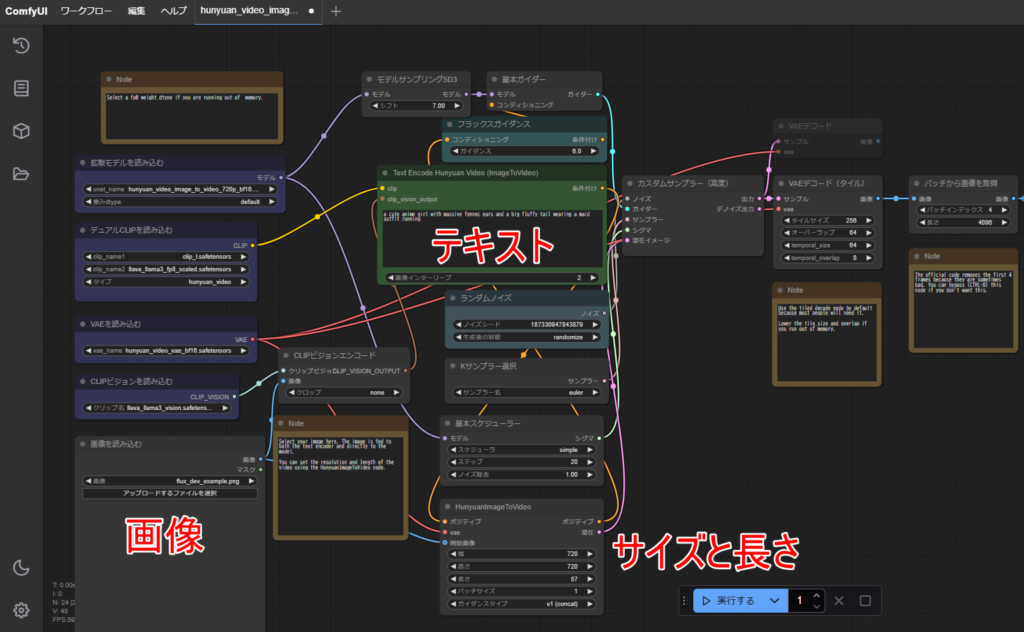

ComfyUIとは、画像・動画生成AIをノードベースで操作できるGUIツールです。

複雑な生成作業をノードと呼ばれる単位に分割し、線で繋げてワークフローを作り、視覚的に分かりやすく管理できます。

ComfyUIの環境構築をするのにも様々な方法があるのですが、複数のツールをまとめて管理できる「Stability Matrix」が便利なのではないかと思います。

ComfyUIを含め、WebUIやForgeなどとモデルを共有し、切り替えて使用できるようになります。

つまり「Stability Matrix」の上に「ComfyUI」をインストールし、ComfyUIのワークフローとして「HunyuanVideo」を読み込む、という形となります。

推奨スペックは?

HunyuanVideoの推奨スペックは、以下のようになっています。

- NVIDIA GPUが必須

- 720x1280の場合、GPUメモリ60GB以上

- 544x960の場合、GPUメモリ45GB以上

ちなみに、現在最新のNVIDIA GeForce RTX 5090のメモリが32GBです。

つまり、普通の家庭用PCで推奨スペックを満たすことは難しく、業務用環境が必要となります。

しかし、私のGPUメモリ12GBの環境でも、テキストからの動画生成は、なんとか実行できました。画像からの動画生成は無理でした。

RTX 5090ならば、推奨スペック以下ではありますが、画像からの動画生成もできるのかもしれません。

商用利用できる?

HunyuanVideoは商用利用可能ですが、条件が複雑なため、おすすめはしません。

まず、月間アクティブユーザー(MAU)が1億人を超える場合は別途ライセンス取得が必要です。

EU、イギリス、韓国ではHunyuanVideoの使用自体が禁止されています。

軍事、医療、法律、誤認誘導、他のAIモデルへの訓練など、多くの禁止事項があります。

「Powered by Tencent Hunyuan」と表示することが推奨されています。

詳細はLICENSE.txtをご参照ください。

HunyuanVideoとComfyUIの使い方

Windowsのローカル環境で、ComfyUIを用いてHunyuanVideoを実行する方法をご紹介します。

ComfyUIのインストール

まず、Stability MatrixおよびComfyUIのインストールが必要となります。

詳細は、下記の記事をご参照ください。

-

画像生成AIを簡単に管理できるComfyUIとStability Matrixの使い方

2025/5/2 ComfyUI, Stable Diffusion, 画像生成

画像生成AIでは、WebUI(Automatic1111)に代わり、ComfyUIが必要となる場面が増えてきました。しかし切り替えて使用することも多いため、複数のUIツールを管理できるStabilit ...

テキストからの動画生成

ComfyUIに、HunyuanVideoのモデルとワークフローを読み込み、テキストから動画生成する方法をご紹介します。

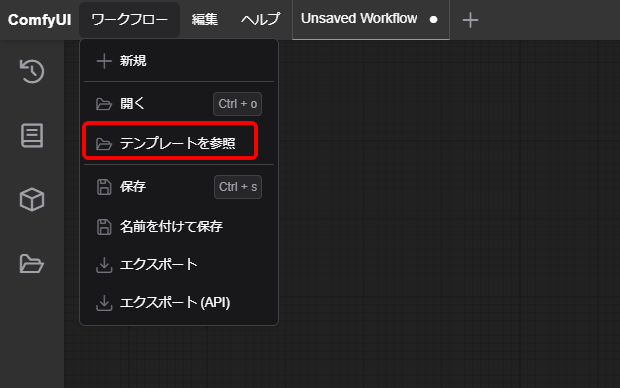

ワークフローの読み込み

テキストからの動画生成であれば、テンプレートが用意されているので、それを読み込むだけです。

左上の「ワークフロー」から、「テンプレートを参照」をクリックします。

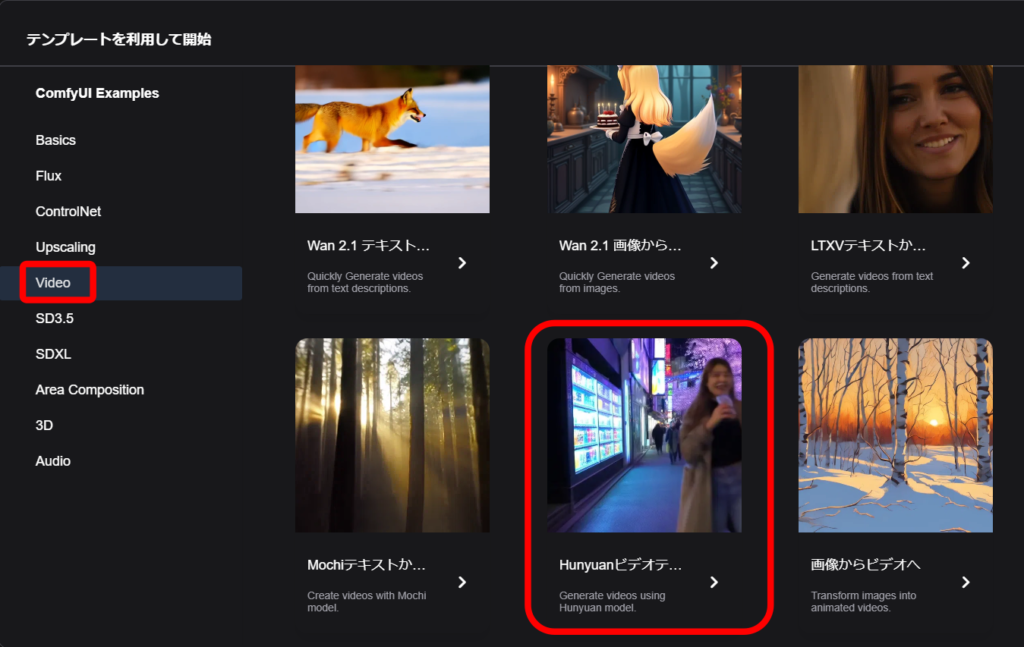

「Video」から「Hunyuan」を選択します。

ComfyUIのバージョンによっては、テンプレートが入っていない可能性もあります。

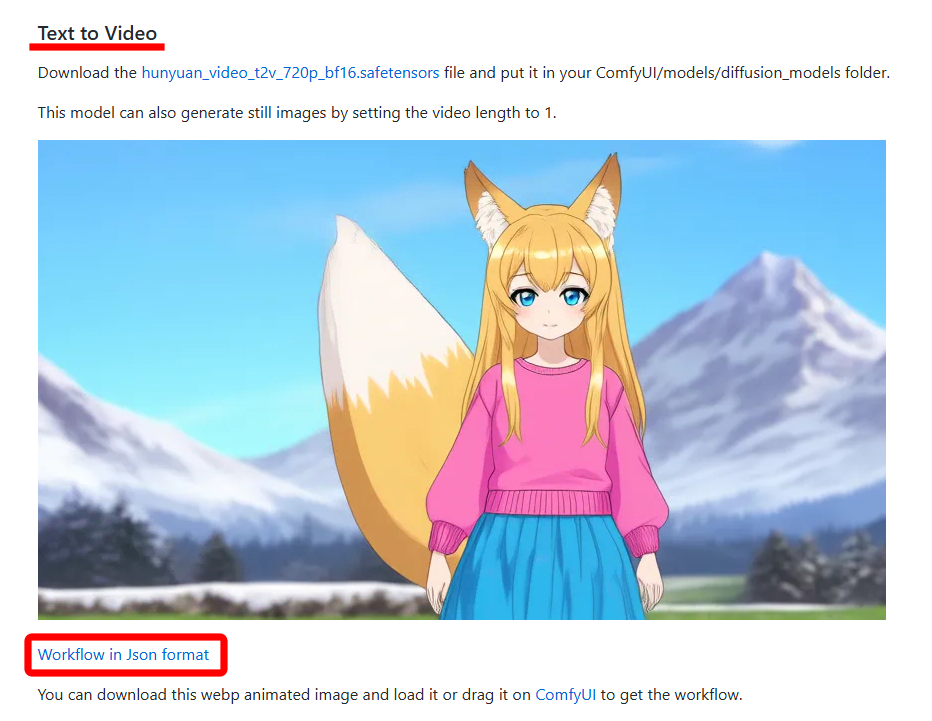

その場合はComfyUI_examplesのページを開き、「Text to Video」の欄の「Workflow in Json format」を右クリックしてダウンロードします。

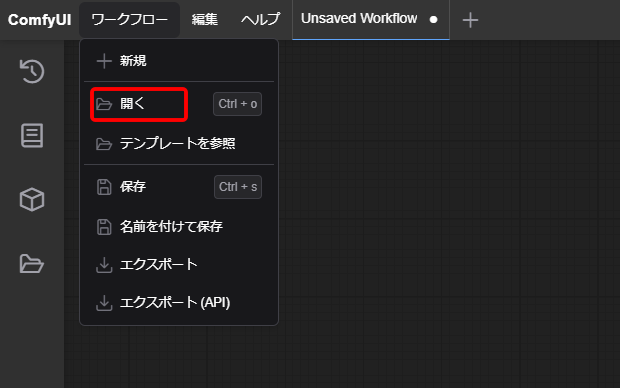

「ワークフロー」の「開く」をクリックし、ダウンロードしたファイルを選択します。

モデルのダウンロード

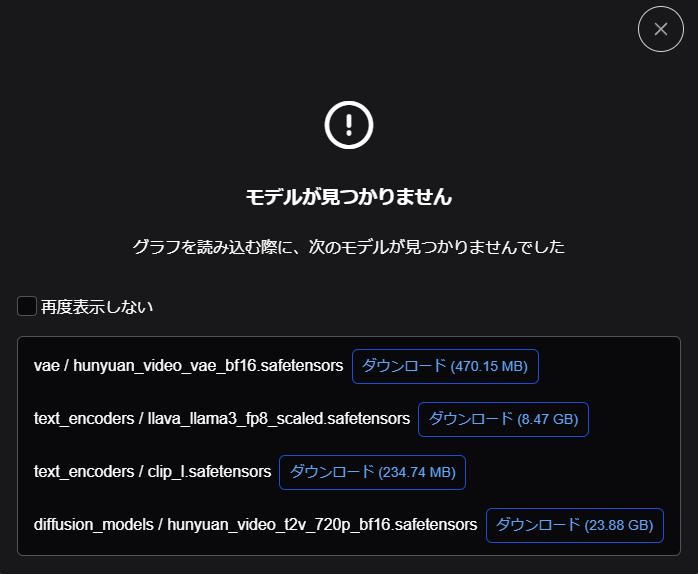

ワークフローを読み込むと、足りないモデルを教えてくれるので、全てダウンロードします。

ここで、ComfyUI単体であれば指定されたフォルダにダウンロードすればいいのですが、Stability Matlixを使用している場合は、共有フォルダの「Data\Models」以下のフォルダに置くようにします。

| モデル | ComfyUI | Stability Matrix |

|---|---|---|

| hunyuan_video_vae_bf16.safetensors | vae | VAE |

| llava_llama3_fp8_scaled.safetensors | text_encorders | CLIP |

| clip_l.safetensors | text_encorders | CLIP |

| hunyuan_video_t2v_720p_bf16.safetensors | diffusion_models | UNET |

作法として正しいのかは分からないのですが、一応これで動いています。

対応フォルダは、Stability Matrixのバージョンによって変わるようです。

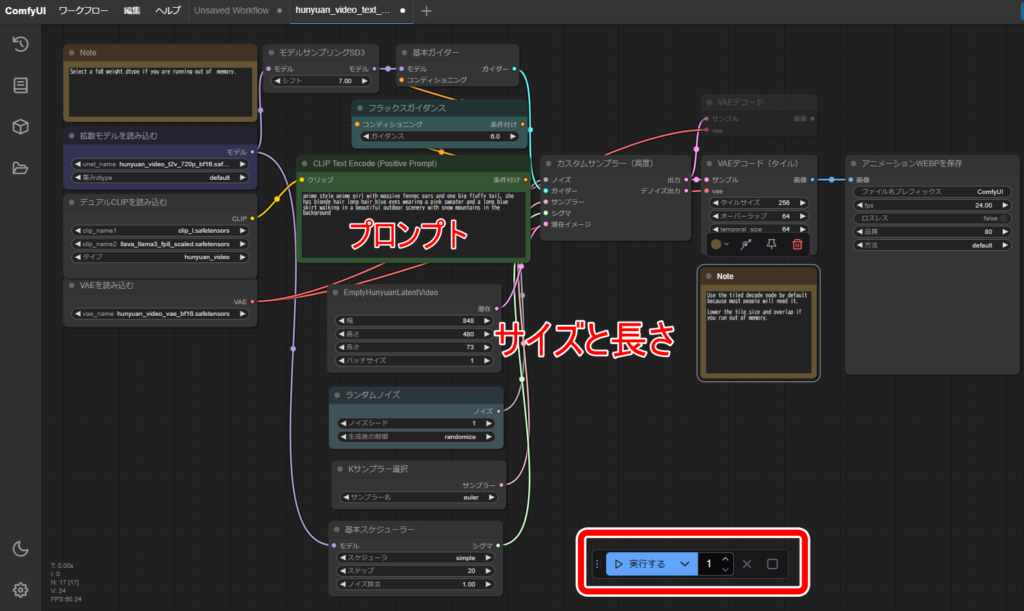

調整

モデルが正しく読み込まれたら、パラメーターを入力します。

基本的にはテキストプロンプトを入力し、画面サイズと長さを指定するだけです。

メモリが不足する場合などは、調整が必要となります。

実行

サンプルプロンプトとして以下の内容が入っていたので、そのまま実行してみました。

anime style anime girl with massive fennec ears and one big fluffy tail, she has blonde hair long hair blue eyes wearing a pink sweater and a long blue skirt walking in a beautiful outdoor scenery with snow mountains in the background

大きななフェネックの耳とふわふわの大きな尻尾を持つアニメ風の女の子。金髪、長髪、青い目をしており、ピンクのセーターを着て、青いロングスカートをはき、雪山を背景にした美しい屋外の風景の中を歩いている。

以下のような動画が生成されました。(ブラウザによってはアニメーションが再生されないかもしれません)

画像からの動画生成

同じ手順で、静止画像から動画生成をすることもできます。

ただし、私の環境ではスペック不足により実行できませんでした。

ワークフローの読み込み

テンプレートが用意されていないので、ComfyUI_examplesのページから「Image to Video」のワークフローをダウンロードします。

v1とv2の2種類あります。

調整

ワークフローに画像のアップロードが追加されています。

実行(失敗)

そのまま実行すると、途中でComfyUIが落ちてしまい、接続エラーとなりました。

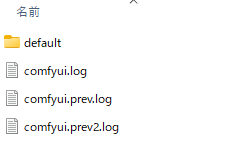

ログは「Data\Packages\ComfyUI\user」で確認できるのですが、異常終了のためか、エラーの内容は記録されていませんでした。

おそらくメモリ不足によるものと思われます。

色々と設定を調整してみましたが無理でした。

HunyuanVideoとComfyUIのまとめ

HunyuanVideoは、テンセントが開発した動画生成AIモデルです。

Windowsローカル環境でHunyuanVideoを実行するには、ComfyUIが便利です。

ComfyUIを実行するには、Stability Matrixが便利です。

Stability MatrixとComfyUIを利用すれば、テンプレートを読み込みだけで、簡単に動画生成ができます。

ただし、高スペックのPCが必要となります。

テキストプロンプトからの動画生成であれば何とかなるかもしれませんが、画像からの動画生成は厳しいかもしれません。

現在、様々なツールが開発されているのと同時に、低スペックで動作するような方法も研究されているので、もう少し待つと気軽に利用できるようになるかもしれません。